Dependencia lineal de vectores.

Al resolver varios problemas, por regla general, no hay que tratar con un solo vector, sino con un determinado conjunto de vectores de la misma dimensión. Estos agregados se denominan sistema de vectores y denotar

Definición.Combinación lineal de vectores. llamado vector de la forma

¿Dónde están los números reales? También se dice que un vector está expresado linealmente en términos de vectores o descompuesto en estos vectores.

Por ejemplo, sean dados tres vectores: , , . Su combinación lineal con los coeficientes 2, 3 y 4, respectivamente, es el vector

Definición. El conjunto de todas las combinaciones lineales posibles de un sistema de vectores se llama tramo lineal de este sistema.

Definición. Un sistema de vectores distintos de cero se llama linealmente dependiente, si hay números que no son simultáneamente iguales a cero, de modo que la combinación lineal de un sistema dado con los números indicados sea igual al vector cero:

Si la última igualdad para un sistema dado de vectores es posible solo para , entonces este sistema de vectores se llama independiente linealmente.

Por ejemplo, un sistema de dos vectores es linealmente independiente; sistema de dos vectores y es linealmente dependiente, ya que .

Sea linealmente dependiente el sistema de vectores (19). Seleccionemos el término de la suma (20) en el que el coeficiente es , y expresémoslo a través de los términos restantes:

Como puede verse en esta igualdad, uno de los vectores del sistema linealmente dependiente (19) resultó estar expresado en términos de otros vectores de este sistema (o expandido en términos de sus vectores restantes).

Propiedades de un sistema vectorial linealmente dependiente

1. Un sistema que consta de un vector distinto de cero es linealmente independiente.

2. Un sistema que contiene un vector cero siempre es linealmente dependiente.

3. Un sistema que contiene más de un vector es linealmente dependiente si y sólo si sus vectores contienen al menos un vector que se expresa linealmente en términos de los demás.

El significado geométrico de una relación lineal en el caso de vectores bidimensionales en un plano: cuando un vector se expresa a través de otro, tenemos, es decir, estos vectores son colineales, o lo que es lo mismo, situados sobre rectas paralelas.

En el caso espacial de dependencia lineal de tres vectores, son paralelos al mismo plano, es decir coplanar. Basta “corregir” las longitudes de estos vectores con los factores correspondientes para que uno de ellos sea la suma de los otros dos o se exprese a través de ellos.

Teorema. En el espacio, cualquier sistema que contenga vectores es linealmente dependiente en .

Ejemplo. Descubra si los vectores son linealmente dependientes.

Solución. Hagamos una igualdad vectorial. Escribiendo en forma de vector de columna, obtenemos

Así, el problema se redujo a resolver el sistema.

Resolvamos el sistema usando el método gaussiano:

Como resultado, obtenemos un sistema de ecuaciones:

que tiene un número infinito de soluciones, entre las cuales seguramente habrá una distinta de cero, por lo tanto, los vectores son linealmente dependientes.

Dejar l es un espacio lineal arbitrario, a i Î L,- sus elementos (vectores).

Definición 3.3.1. Expresión , Dónde , - números reales arbitrarios, llamados combinación lineal vectores un 1, un 2,…, un norte.

si el vector R = , entonces dicen que R descompuesto en vectores un 1, un 2,…, un norte.

Definición 3.3.2. Una combinación lineal de vectores se llama no trivial, si entre los números hay al menos uno distinto de cero. De lo contrario, la combinación lineal se llama trivial.

Definición 3.3.3 . Vectores a 1 , a 2 ,…, a norte se llaman linealmente dependientes si existe una combinación lineal no trivial de ellos tal que

= 0 .

Definición 3.3.4. Vectores a 1 ,a 2 ,…, a norte se llaman linealmente independientes si la igualdad = 0 sólo es posible en el caso de que todos los números yo 1, yo 2,…, l norte son simultáneamente iguales a cero.

Tenga en cuenta que cualquier elemento distinto de cero a 1 puede considerarse como un sistema linealmente independiente, ya que la igualdad yo un 1 = 0 posible sólo si yo= 0.

Teorema 3.3.1. Una condición necesaria y suficiente para la dependencia lineal a 1 , a 2 ,…, a norte es la posibilidad de descomponer al menos uno de estos elementos en el resto.

Prueba. Necesidad. Sean los elementos a 1 , a 2 ,…, a norte linealmente dependiente. Esto significa que = 0 , y al menos uno de los números yo 1, yo 2,…, l norte diferente de cero. Dejar con certeza yo 1 ¹ 0. Entonces

es decir, el elemento a 1 se descompone en elementos a 2, a 3,…, a norte.

Adecuación. Sea el elemento a 1 descompuesto en los elementos a 2 , a 3 , …, a norte, es decir, un 1 = . Entonces = 0 , por lo tanto, existe una combinación lineal no trivial de vectores a 1 , a 2 ,…, a norte, igual 0 , por lo que son linealmente dependientes .

Teorema 3.3.2. Si al menos uno de los elementos a 1 , a 2 ,…, a norte cero, entonces estos vectores son linealmente dependientes.

Prueba . Dejar a norte= 0 , entonces = 0 , lo que significa la dependencia lineal de estos elementos.

Teorema 3.3.3. Si entre n vectores cualquier p (p< n) векторов линейно зависимы, то и все n элементов линейно зависимы.

Prueba. Sean, para mayor precisión, los elementos a 1 , a 2 ,…, a pag linealmente dependiente. Esto significa que existe una combinación lineal no trivial tal que = 0 . La igualdad especificada se conservará si agregamos el elemento a ambas partes. Entonces + = 0 , y al menos uno de los números yo 1, yo 2,…, lp diferente de cero. Por lo tanto, los vectores a 1 , a 2 ,…, a norte son linealmente dependientes.

Corolario 3.3.1. Si n elementos son linealmente independientes, entonces cualesquiera k de ellos son linealmente independientes (k< n).

Teorema 3.3.4. Si los vectores un 1, un 2,…, un norte- 1 son linealmente independientes y los elementos un 1, un 2,…, un norte- 1, un n son linealmente dependientes, entonces el vector a n se puede expandir en vectores un 1, un 2,…, un norte- 1 .

Prueba. Dado que por condición a 1 , a 2 ,…, a norte- 1, un norte son linealmente dependientes, entonces existe una combinación lineal no trivial de ellos = 0 , y (de lo contrario, los vectores a 1 , a 2 ,…, a resultarán linealmente dependientes norte- 1). Pero entonces el vector

Q.E.D.

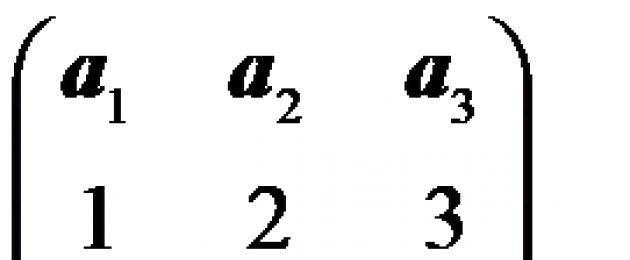

Tarea 1. Descubra si el sistema de vectores es linealmente independiente. El sistema de vectores estará especificado por la matriz del sistema, cuyas columnas están formadas por las coordenadas de los vectores.

.

.

Solución. Sea la combinación lineal  igual a cero. Habiendo escrito esta igualdad en coordenadas, obtenemos el siguiente sistema de ecuaciones:

igual a cero. Habiendo escrito esta igualdad en coordenadas, obtenemos el siguiente sistema de ecuaciones:

.

.

Este sistema de ecuaciones se llama triangular. Ella solo tiene una solución.  . Por lo tanto, los vectores

. Por lo tanto, los vectores  independiente linealmente.

independiente linealmente.

Tarea 2. Descubra si el sistema de vectores es linealmente independiente.

.

.

Solución. Vectores  son linealmente independientes (ver problema 1). Demostremos que el vector es una combinación lineal de vectores.

son linealmente independientes (ver problema 1). Demostremos que el vector es una combinación lineal de vectores.  . Coeficientes de expansión vectorial

. Coeficientes de expansión vectorial  se determinan a partir del sistema de ecuaciones

se determinan a partir del sistema de ecuaciones

.

.

Este sistema, al igual que el triangular, tiene una solución única.

Por tanto, el sistema de vectores.  linealmente dependiente.

linealmente dependiente.

Comentario. Las matrices del mismo tipo que en el problema 1 se llaman triangular , y en el problema 2 – triangular escalonado . La cuestión de la dependencia lineal de un sistema de vectores se resuelve fácilmente si la matriz compuesta por las coordenadas de estos vectores es triangular escalonada. Si la matriz no tiene una forma especial, entonces usando conversiones de cadenas elementales , preservando las relaciones lineales entre las columnas, se puede reducir a una forma triangular escalonada.

Conversiones de cadenas elementales matrices (EPS) las siguientes operaciones sobre una matriz se denominan:

1) reordenamiento de líneas;

2) multiplicar una cadena por un número distinto de cero;

3) agregar otra cadena a una cadena, multiplicada por un número arbitrario.

Tarea 3. Encuentre el subsistema linealmente independiente máximo y calcule el rango del sistema de vectores.

.

.

Solución. Reduzcamos la matriz del sistema usando EPS a una forma triangular escalonada. Para explicar el procedimiento, denotamos la línea con el número de la matriz a transformar con el símbolo . La columna después de la flecha indica las acciones en las filas de la matriz que se está convirtiendo que se deben realizar para obtener las filas de la nueva matriz.

.

.

Obviamente, las dos primeras columnas de la matriz resultante son linealmente independientes, la tercera columna es su combinación lineal y la cuarta no depende de las dos primeras. Vectores  se llaman básicos. Forman un subsistema linealmente independiente máximo del sistema.

se llaman básicos. Forman un subsistema linealmente independiente máximo del sistema.  , y el rango del sistema es tres.

, y el rango del sistema es tres.

Base, coordenadas

Tarea 4. Encuentre la base y las coordenadas de los vectores en esta base en el conjunto de vectores geométricos cuyas coordenadas satisfacen la condición  .

.

Solución. El conjunto es un plano que pasa por el origen. Una base arbitraria en un plano consta de dos vectores no colineales. Las coordenadas de los vectores en la base seleccionada se determinan resolviendo el correspondiente sistema de ecuaciones lineales.

Hay otra forma de resolver este problema, cuando puedes encontrar la base usando las coordenadas.

Coordenadas  los espacios no son coordenadas en el plano, ya que están relacionados por la relación

los espacios no son coordenadas en el plano, ya que están relacionados por la relación  , es decir, no son independientes. Las variables independientes y (se llaman libres) definen de forma única un vector en el plano y, por tanto, pueden elegirse como coordenadas en . Entonces la base

, es decir, no son independientes. Las variables independientes y (se llaman libres) definen de forma única un vector en el plano y, por tanto, pueden elegirse como coordenadas en . Entonces la base  consta de vectores que se encuentran y corresponden a conjuntos de variables libres

consta de vectores que se encuentran y corresponden a conjuntos de variables libres  Y

Y  , eso es .

, eso es .

Tarea 5. Encuentre la base y las coordenadas de los vectores en esta base en el conjunto de todos los vectores en el espacio cuyas coordenadas impares son iguales entre sí.

Solución. Elijamos, como en el problema anterior, coordenadas en el espacio.

Porque  , luego variables libres

, luego variables libres  determinan de forma única el vector desde y, por lo tanto, son coordenadas. La base correspondiente consta de vectores.

determinan de forma única el vector desde y, por lo tanto, son coordenadas. La base correspondiente consta de vectores.

Tarea 6. Encuentre la base y las coordenadas de los vectores en esta base en el conjunto de todas las matrices de la forma  , Dónde

, Dónde  – números arbitrarios.

– números arbitrarios.

Solución. Cada matriz de es representable de forma única en la forma:

Esta relación es la expansión del vector con respecto a la base.  con coordenadas

con coordenadas  .

.

Tarea 7. Encuentre la dimensión y la base del casco lineal de un sistema de vectores.

.

.

Solución. Usando el EPS, transformamos la matriz de las coordenadas de los vectores del sistema a una forma triangular escalonada.

.

.

columnas  las últimas matrices son linealmente independientes y las columnas

las últimas matrices son linealmente independientes y las columnas  expresado linealmente a través de ellos. Por lo tanto, los vectores

expresado linealmente a través de ellos. Por lo tanto, los vectores  formar una base

formar una base  , Y

, Y  .

.

Comentario. base en  se elige de forma ambigua. Por ejemplo, vectores

se elige de forma ambigua. Por ejemplo, vectores  también forma una base

también forma una base  .

.

Definición. Combinación lineal de vectores. a 1 , ..., a n con coeficientes x 1 , ..., x n se llama vector

x 1 un 1 + ... + x norte un norte .

trivial, si todos los coeficientes x 1 , ..., x n son iguales a cero.

Definición. La combinación lineal x 1 a 1 + ... + x n a n se llama no trivial, si al menos uno de los coeficientes x 1, ..., x n no es igual a cero.

independiente linealmente, si no existe una combinación no trivial de estos vectores igual al vector cero.

Es decir, los vectores a 1, ..., an son linealmente independientes si x 1 a 1 + ... + x n a n = 0 si y solo si x 1 = 0, ..., x n = 0.

Definición. Los vectores a 1, ..., an se llaman linealmente dependiente, si existe una combinación no trivial de estos vectores igual al vector cero.

Propiedades de vectores linealmente dependientes:

Para vectores n-dimensionales.

n + 1 vectores siempre son linealmente dependientes.

Para vectores bidimensionales y tridimensionales.

Dos vectores linealmente dependientes son colineales. (Los vectores colineales son linealmente dependientes).

Para vectores tridimensionales.

Tres vectores linealmente dependientes son coplanares. (Tres vectores coplanares son linealmente dependientes).

Ejemplos de problemas de dependencia lineal e independencia lineal de vectores:

Ejemplo 1. Comprueba si los vectores a = (3; 4; 5), b = (-3; 0; 5), c = (4; 4; 4), d = (3; 4; 0) son linealmente independientes .

Solución:

Los vectores serán linealmente dependientes, ya que la dimensión de los vectores es menor que el número de vectores.

Ejemplo 2. Comprueba si los vectores a = (1; 1; 1), b = (1; 2; 0), c = (0; -1; 1) son linealmente independientes.

Solución:

| x1 + x2 = 0 | |

| x 1 + 2 x 2 - x 3 = 0 | |

| x1 + x3 = 0 |

| 1 | 1 | 0 | 0 | ~ | ||

| 1 | 2 | -1 | 0 | |||

| 1 | 0 | 1 | 0 |

| ~ | 1 | 1 | 0 | 0 | ~ | 1 | 1 | 0 | 0 | ~ | ||||

| 1 - 1 | 2 - 1 | -1 - 0 | 0 - 0 | 0 | 1 | -1 | 0 | |||||||

| 1 - 1 | 0 - 1 | 1 - 0 | 0 - 0 | 0 | -1 | 1 | 0 |

reste el segundo de la primera línea; agregue una segunda línea a la tercera línea:

| ~ | 1 - 0 | 1 - 1 | 0 - (-1) | 0 - 0 | ~ | 1 | 0 | 1 | 0 | ||||

| 0 | 1 | -1 | 0 | 0 | 1 | -1 | 0 | ||||||

| 0 + 0 | -1 + 1 | 1 + (-1) | 0 + 0 | 0 | 0 | 0 | 0 |

Esta solución muestra que el sistema tiene muchas soluciones, es decir, existe una combinación distinta de cero de valores de los números x 1, x 2, x 3 tal que la combinación lineal de los vectores a, b, c es igual a el vector cero, por ejemplo:

A + b + c = 0

lo que significa que los vectores a, b, c son linealmente dependientes.

Respuesta: los vectores a, b, c son linealmente dependientes.

Ejemplo 3. Comprueba si los vectores a = (1; 1; 1), b = (1; 2; 0), c = (0; -1; 2) son linealmente independientes.

Solución: Encontremos los valores de los coeficientes en los que la combinación lineal de estos vectores será igual al vector cero.

x 1 a + x 2 b + x 3 c 1 = 0Esta ecuación vectorial se puede escribir como un sistema de ecuaciones lineales.

| x1 + x2 = 0 | |

| x 1 + 2 x 2 - x 3 = 0 | |

| x1 + 2x3 = 0 |

Resolvamos este sistema usando el método de Gauss.

| 1 | 1 | 0 | 0 | ~ | ||

| 1 | 2 | -1 | 0 | |||

| 1 | 0 | 2 | 0 |

reste la primera de la segunda línea; resta la primera de la tercera línea:

| ~ | 1 | 1 | 0 | 0 | ~ | 1 | 1 | 0 | 0 | ~ | ||||

| 1 - 1 | 2 - 1 | -1 - 0 | 0 - 0 | 0 | 1 | -1 | 0 | |||||||

| 1 - 1 | 0 - 1 | 2 - 0 | 0 - 0 | 0 | -1 | 2 | 0 |

reste el segundo de la primera línea; agregue una segunda a la tercera línea.

Introducido por nosotros operaciones lineales sobre vectores permiten crear varias expresiones para cantidades vectoriales y transformarlos usando las propiedades establecidas para estas operaciones.

Con base en un conjunto dado de vectores a 1, ..., an, puedes crear una expresión de la forma

donde a 1, ... y n son números reales arbitrarios. Esta expresión se llama combinación lineal de vectores un 1, ..., un n. Los números α i, i = 1, n, representan coeficientes de combinación lineal. Un conjunto de vectores también se llama sistema de vectores.

En relación con el concepto introducido de combinación lineal de vectores, surge el problema de describir un conjunto de vectores que pueda escribirse como una combinación lineal de un sistema dado de vectores a 1, ..., a n. Además, surgen naturalmente preguntas sobre las condiciones bajo las cuales se produce la representación de un vector en forma de combinación lineal y sobre la unicidad de dicha representación.

Definición 2.1. Los vectores a 1, ... y n se denominan linealmente dependiente, si existe un conjunto de coeficientes α 1 , ... , α n tales que

α 1 a 1 + ... + α n а n = 0 (2.2)

y al menos uno de estos coeficientes es distinto de cero. Si el conjunto especificado de coeficientes no existe, entonces los vectores se llaman independiente linealmente.

Si α 1 = ... = α n = 0, entonces, obviamente, α 1 a 1 + ... + α n a n = 0. Teniendo esto en cuenta, podemos decir esto: vectores a 1, ..., y n son linealmente independientes si de la igualdad (2.2) se deduce que todos los coeficientes α 1 , ... , α n son iguales a cero.

El siguiente teorema explica por qué el nuevo concepto se denomina término "dependencia" (o "independencia") y proporciona un criterio simple para la dependencia lineal.

Teorema 2.1. Para que los vectores a 1, ..., y n, n > 1, sean linealmente dependientes, es necesario y suficiente que uno de ellos sea combinación lineal de los demás.

◄ Necesidad. Supongamos que los vectores a 1, ... y n son linealmente dependientes. Según la Definición 2.1 de dependencia lineal, en la igualdad (2.2) a la izquierda hay al menos un coeficiente distinto de cero, por ejemplo α 1. Dejando el primer término al lado izquierdo de la igualdad, movemos el resto al lado derecho, cambiando sus signos, como es habitual. Dividiendo la igualdad resultante por α 1, obtenemos

un 1 =-α 2 /α 1 ⋅ un 2 - ... - α n /α 1 ⋅ un n

aquellos. representación del vector a 1 como combinación lineal de los vectores restantes a 2, ..., a n.

Adecuación. Dejemos, por ejemplo, que el primer vector a 1 se pueda representar como una combinación lineal de los vectores restantes: a 1 = β 2 a 2 + ... + β n a n. Transfiriendo todos los términos del lado derecho al izquierdo, obtenemos a 1 - β 2 a 2 - ... - β n a n = 0, es decir una combinación lineal de vectores a 1, ..., a n con coeficientes α 1 = 1, α 2 = - β 2, ..., α n = - β n, igual a vector cero. En esta combinación lineal, no todos los coeficientes son cero. Según la Definición 2.1, los vectores a 1, ... y n son linealmente dependientes.

La definición y el criterio de dependencia lineal se formulan para implicar la presencia de dos o más vectores. Sin embargo, también podemos hablar de una dependencia lineal de un vector. Para realizar esta posibilidad, en lugar de "los vectores son linealmente dependientes", es necesario decir "el sistema de vectores es linealmente dependiente". Es fácil ver que la expresión "un sistema de un vector es linealmente dependiente" significa que este único vector es cero (en una combinación lineal solo hay un coeficiente y no debe ser igual a cero).

El concepto de dependencia lineal tiene una interpretación geométrica simple. Las siguientes tres afirmaciones aclaran esta interpretación.

Teorema 2.2. Dos vectores son linealmente dependientes si y sólo si colineal.

◄ Si los vectores a y b son linealmente dependientes, entonces uno de ellos, por ejemplo a, se expresa a través del otro, es decir a = λb para algún número real λ. Según la definición 1.7 obras vectores por número, los vectores a y b son colineales.

Sean ahora los vectores a y b colineales. Si ambos son cero, entonces es obvio que son linealmente dependientes, ya que cualquier combinación lineal de ellos es igual al vector cero. Sea uno de estos vectores distinto de 0, por ejemplo el vector b. Denotemos por λ la relación de longitudes de vectores: λ = |a|/|b|. Los vectores colineales pueden ser unidireccional o dirigido de manera opuesta. En el último caso, cambiamos el signo de λ. Luego, comprobando la Definición 1.7, estamos convencidos de que a = λb. Según el teorema 2.1, los vectores a y b son linealmente dependientes.

Observación 2.1. En el caso de dos vectores, teniendo en cuenta el criterio de dependencia lineal, el teorema demostrado se puede reformular de la siguiente manera: dos vectores son colineales si y sólo si uno de ellos se representa como producto del otro por un número. Este es un criterio conveniente para la colinealidad de dos vectores.

Teorema 2.3. Tres vectores son linealmente dependientes si y sólo si coplanar.

◄ Si tres vectores a, b, c son linealmente dependientes, entonces, según el teorema 2.1, uno de ellos, por ejemplo a, es una combinación lineal de los demás: a = βb + γc. Combinemos los orígenes de los vectores b y c en el punto A. Entonces los vectores βb, γс tendrán un origen común en el punto A y a lo largo según la regla del paralelogramo, su suma es aquellos. el vector a será un vector con origen A y el fin, que es el vértice de un paralelogramo construido sobre vectores componentes. Por tanto, todos los vectores se encuentran en el mismo plano, es decir, coplanares.

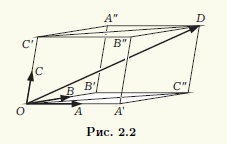

Sean coplanares los vectores a, b, c. Si uno de estos vectores es cero, obviamente será una combinación lineal de los demás. Basta con tomar todos los coeficientes de una combinación lineal iguales a cero. Por tanto, podemos suponer que los tres vectores no son cero. Compatible comenzó de estos vectores en un punto común O. Sean sus extremos los puntos A, B, C, respectivamente (figura 2.1). Por el punto C trazamos rectas paralelas a rectas que pasan por pares de puntos O, A y O, B. Designando los puntos de intersección como A" y B", obtenemos un paralelogramo OA"CB", por tanto, OC" = OA" + OB". El vector OA" y el vector distinto de cero a = OA son colineales, por lo que el primero de ellos se puede obtener multiplicando el segundo por un número real α:OA" = αOA. De manera similar, OB" = βOB, β ∈ R. Como resultado, obtenemos que OC" = α OA + βOB, es decir, el vector c es una combinación lineal de los vectores a y b. Según el teorema 2.1, los vectores a, b, c son linealmente dependientes.

Teorema 2.4. Cualesquiera cuatro vectores son linealmente dependientes.

◄ Realizamos la demostración según el mismo esquema que en el Teorema 2.3. Considere cuatro vectores arbitrarios a, b, cy d. Si uno de los cuatro vectores es cero, o entre ellos hay dos vectores colineales, o tres de los cuatro vectores son coplanares, entonces estos cuatro vectores son linealmente dependientes. Por ejemplo, si los vectores a y b son colineales, entonces podemos hacer su combinación lineal αa + βb = 0 con coeficientes distintos de cero, y luego agregar los dos vectores restantes a esta combinación, tomando ceros como coeficientes. Obtenemos una combinación lineal de cuatro vectores igual a 0, en la que hay coeficientes distintos de cero.

Por lo tanto, podemos suponer que entre los cuatro vectores seleccionados, ningún vector es cero, ningún dos es colineal y ningún tres es coplanar. Elijamos como comienzo común el punto O. Entonces los extremos de los vectores a, b, c, d serán algunos puntos A, B, C, D (figura 2.2). Por el punto D trazamos tres planos paralelos a los planos OBC, OCA, OAB, y sean A", B", C" los puntos de intersección de estos planos con las rectas OA, OB, OS, respectivamente. Obtenemos un paralelepípedo OA" C "B" C" B"DA", y los vectores a, b, c se encuentran en sus aristas que emergen del vértice O. Dado que el cuadrilátero OC"DC" es un paralelogramo, entonces OD = OC" + OC". A su vez, el segmento OC" es un paralelogramo diagonal OA"C"B", por lo que OC" = OA" + OB" y OD = OA" + OB" + OC" .

Queda por señalar que los pares de vectores OA ≠ 0 y OA" , OB ≠ 0 y OB" , OC ≠ 0 y OC" son colineales y, por tanto, es posible seleccionar los coeficientes α, β, γ de modo que OA" = αOA, OB" = βOB y OC" = γOC. Finalmente obtenemos OD = αOA + βOB + γOC. En consecuencia, el vector OD se expresa a través de los otros tres vectores y los cuatro vectores, según el teorema 2.1, son linealmente dependientes.

- En contacto con 0

- Google+ 0

- DE ACUERDO 0

- Facebook 0